Dienstag, 2. Juli 2024

Freitag, 28. Juni 2024, vormittags: Ich komme mit der S6 aus Schwarzenburg um 10:54 Uhr im Bahnhof Bern an, und verschiebe gleich anschliessend von Gleis 13 über die Welle zu Gleis 2, um dort um 11:02 Uhr den IC nach Zürich zu besteigen.

Dabei muss es passiert sein: Während ich auf meinen AirPods Pro Kopfhörern Musik hörte, muss mir das AirPods Pro Case mit eingraviertem „EMEIDI“ irgendwie aus der rechten Hosentasche meiner neuen kurzen Hosen gefallen sein.

Es handelt sich um das Lightning-Case, welches mit meinen AirPods Pro A2698 mitgeliefert wurde („AirPods Pro (2nd generation) with MagSafe Charging Case (Lightning)“, gemäss Apple 2022 veröffentlicht). Die Kopfhörer und das Case tragen die Seriennummer Q0F2TGMY55.

Spätestens um 11:59 Uhr, kurz vor der Ankunft in Zürich, realisierte ich den Verlust, weil ich zu dem Zeitpunkt zum ersten Mal einen Screenshot des Case in meiner Find My App auf dem iPhone machte. Dazumal zeigte die App noch an, dass das Case zuletzt um ca. 7 Uhr morgens zu Hause gesehen wurde. Das konnte aber nicht stimmen.

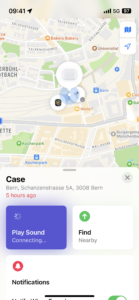

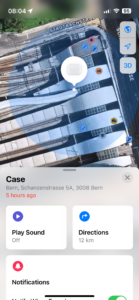

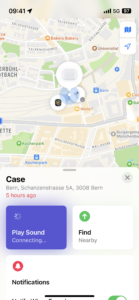

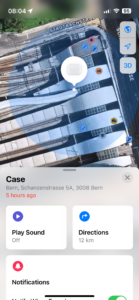

Um 12:11 Uhr dann meldete die Find My App, dass das Case vor einer Stunde zuletzt an der Schanzenstrasse 5A in 3008 Bern gesehen wurde. Ein späterer Screenshot um 23:28 Uhr meldete als „Last seen“ Zeitpunkt 10:55 Uhr.

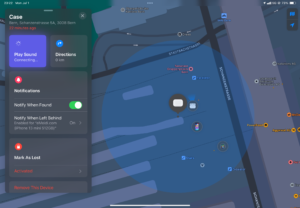

Am Samstag, 29. Juni 2024 um 20:07 Uhr zeigte mir Find My an, dass das Case vor einer Stunde zu Beginn des Zugangs zu Gleis 49 und 50 an der Welle gesehen wurde. Um 23:57 Uhr war das Case 5 Minuten zuvor gesehen worden. Immer noch an derselben Stelle.

Dito für den 1. Juli um 00:15 Uhr (26 Minuten zuvor gesehen), und dann noch einmal um 03:04 Uhr.

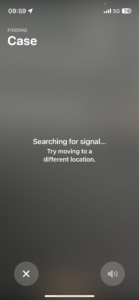

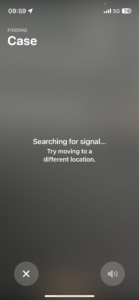

Am Montag, 1. Juli 2024, bin ich am Vormittag in Bern, um einen alten Bekannten zu treffen. Da ich zu früh in Bern bin, verwende ich die verbleibenden 20 Minuten, um meinen Weg am Freitag abzuschreiten. Dann treffe ich mich mit dem Bekannten. Anschliessend an den gemeinsamen Kaffee überrede ich ihn, mit mir meinen Weg vom Freitag durch den Bahnhof abzuschreiten und nach dem AirPods Case Ausschau zu halten. Ich versuche die Ortungsfunktion der Find My App, kann aber das Case weder orten, noch eine Verbindung aufbauen, um einen Ton abzuspielen. Mein iPhone 13 mini wird bei der konstanten Suche sehr heiss, und der Akku leert sich gefühlt im Minutentakt um ein Prozentpunkt.

Später hilft mir meine Frau, das Perron abzuschreiten, und im Kiesbett nach dem AirPods Case Ausschau zu halten. Nichts. Mein iPhone empfängt kein Signal des Cases, obwohl die Find My App etwa eine halbe Stunde später anzeigt, dass das Case während unserer Suchaktion geortet wurde.

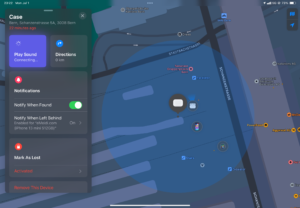

Am späten Abend entschliesse ich mich, noch einmal nach Bern zu fahren, um im halbleeren Bahnhof weiter nach dem Case zu suchen. Ich erhoffe mir durch die deutlich weniger Leute (und somit elektronischen Geräte), das Case einfacher kontaktieren zu können. Dieses Mal habe ich auch mein iPad auch dabei. Leider verfügt dieses nicht über die Ortungsfunktion des iPhone 13 mini mit U1 Chip, weshalb ich mit dem iPad konstant den Find My Button drücke, um auf dem Case einen Ton abzuspielen …

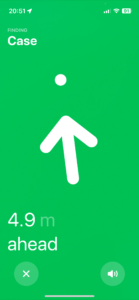

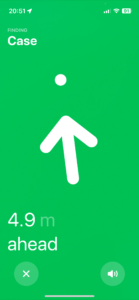

… während ich auf dem iPhone die Lokalisierungsfunktion aktiviert habe, welche mir — bei Verbindungsaufbau — mit einem Pfeil zeigen sollte, wo sich das Case befindet (getestet zu Hause, mit meinem Ersatz AirPods Pro Case mit USB-C, welches den U1 Chip verbaut hat):

Schlussendlich gebe ich auf, und fahre nach Hause. Der Verlust lässt mich aber einfach nicht los, weil der Beacon mir sagt, dass das Case irgendwo bei der Welle im Bahnhof

Überlegungen

- Das Case bewegt sich nicht. Es wird in der Find My App seit Freitag am selben Ort angezeigt. Ich gehe deshalb davon aus, dass es niemand gefunden hat. Könnte es irgendwo im Kiesbett liegen? Doch wieso konnte sich meine Geräte nicht mit den Headphones verbinden?

- Das Case meldet sich gemäss Find My App nur sporadisch — manchmal stundenlang nicht. Dies kann entweder vom Case selber gesteuert werden (bspw. um Batterien zu sparen), oder aber das Case befindet sich zwar im Bahnhof Bern, aber es kommen für einen hochfrequentierten Bahnhof erstaunlicherweise nicht so viele iPhones an ihm vorbei, dass das Signal andauernd empfangen und an Apples Server weitergeleitet wird. Könnte es sein, dass sich das Case absichtlich oder unabsichtlich an einem Ort befindet, wo meistens nur Android-basierte Smartphones vorbeikommen, und selten bis nie iPhones?

- Wie exakt ist die Find My Lokalisierung von Apple wirklich? Man beachte den Radius, der um das Case gezeichnet wird. Ist das Case wirklich im Zentrum, respektive irgendwo in diesem Kreis, oder interpoliert Apple hier und verwendet die nächstgelegene Adresse?

- Auf der Welle gibt es zwei Shops — den Brezelkönig, und den Kiosk. Ich kann mir nicht vorstellen, dass sich das AirPods Case dort befindet, denn dann müsste es meiner Meinung nach fast konstant von iOS-Geräten „gesehen“ werden.

- Wäre das Case im Abfall gelandet, müsste es den Perimeter längst verlassen haben — ich kann mir nicht vorstellen, dass die SBB Abfallkübel fünf Tage lang nicht leeren.